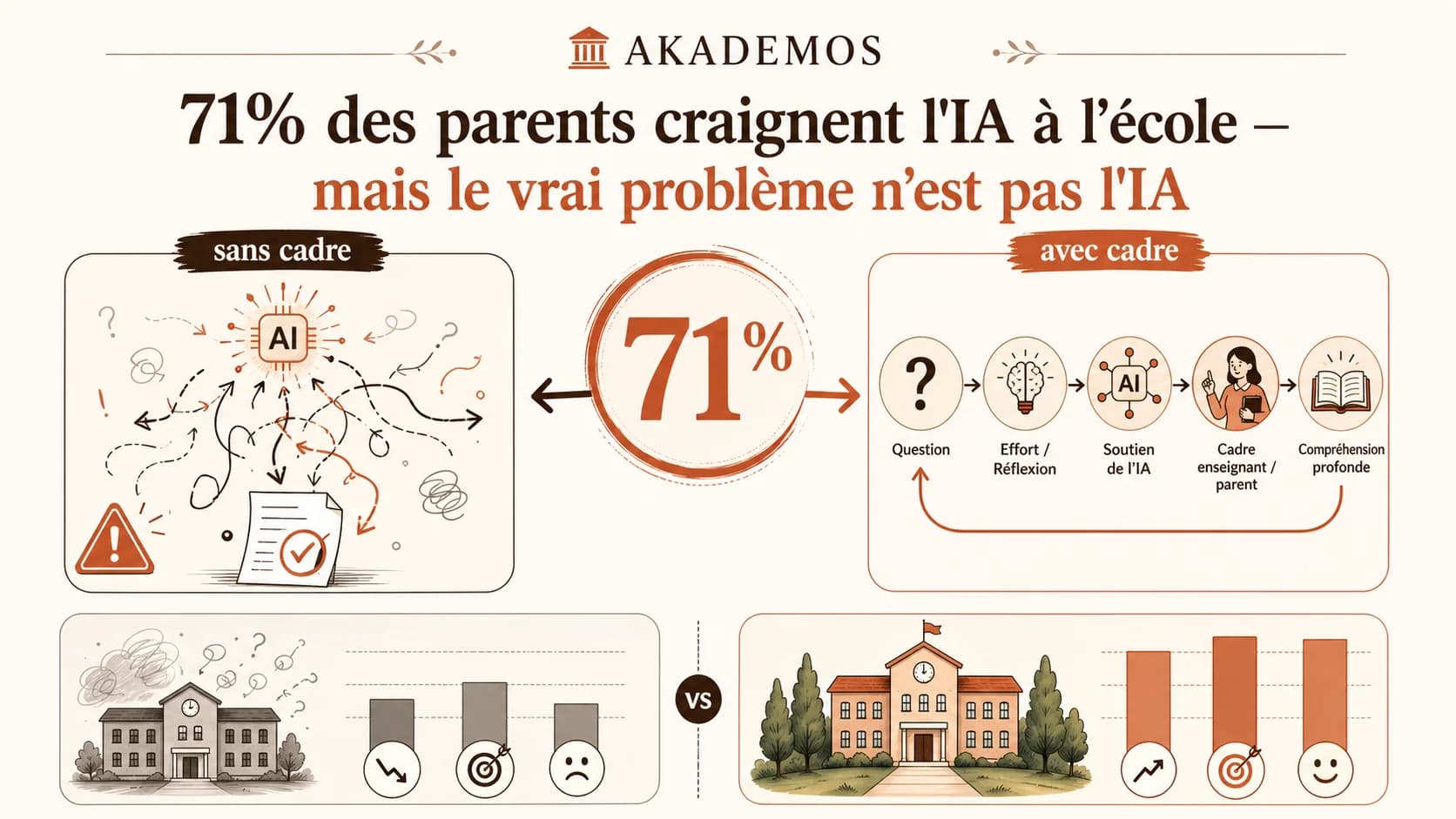

71% des parents craignent l'IA — et ils ont raison de s'inquiéter. Mais pas pour les bonnes raisons.

En bref : 71 % des parents français redoutent la dépendance à l'IA scolaire, mais les données PISA 2022 montrent que les pays encadrant l'IA (Estonie, Finlande) progressent en maths et en lecture.

Selon une étude GoStudent, 71% des parents français craignent que leurs enfants deviennent dépendants de l'IA pour apprendre. C'est beaucoup. Et ça dit quelque chose sur l'état du débat.

Les parents imaginent leur enfant de 10 ans qui tape toutes ses réponses dans ChatGPT sans réfléchir. Qui copie-colle ses devoirs. Qui perd la capacité de penser par lui-même parce qu'une machine le fait à sa place.

Cette crainte n'est pas absurde. Mais elle passe à côté du vrai problème.

Le problème n'est pas l'IA. C'est le chaos.

En bref : Sans cadre pédagogique, l'IA donne les réponses directement dans Les résultats chiffrés doivent être vérifiables et contextualisés avant d'être présentés comme preuve.

Aujourd'hui, un enfant qui utilise l'IA à l'école fait généralement l'une de ces choses :

- Il tape sa question de maths dans ChatGPT et copie la réponse

- Il fait écrire sa rédaction par un chatbot

- Il utilise un traducteur IA pour ses devoirs d'anglais

Dans tous ces cas, l'enfant n'apprend rien. L'IA fait le travail à sa place. Les parents ont raison de s'inquiéter de ça.

Mais ce n'est pas la faute de l'IA. C'est la faute de l'absence de structuré.

ChatGPT est un outil généraliste. Il n'a pas été conçu pour l'éducation. Il répond à n'importe quelle question, donne directement les réponses, et ne vérifie pas si l'enfant a compris. C'est comme donner un livre de corrigés à un élève et espérer qu'il apprenne. La CNIL a d'ailleurs alerté dès 2024 sur les risques de ces outils non encadrés pour les mineurs.

Le problème n'est pas que l'IA existe. C'est qu'on laisse les enfants l'utiliser sans cadre. Le CNNum (Conseil National du Numérique) a formulé des recommandations spécifiques pour aider les parents à encadrer ces usages.

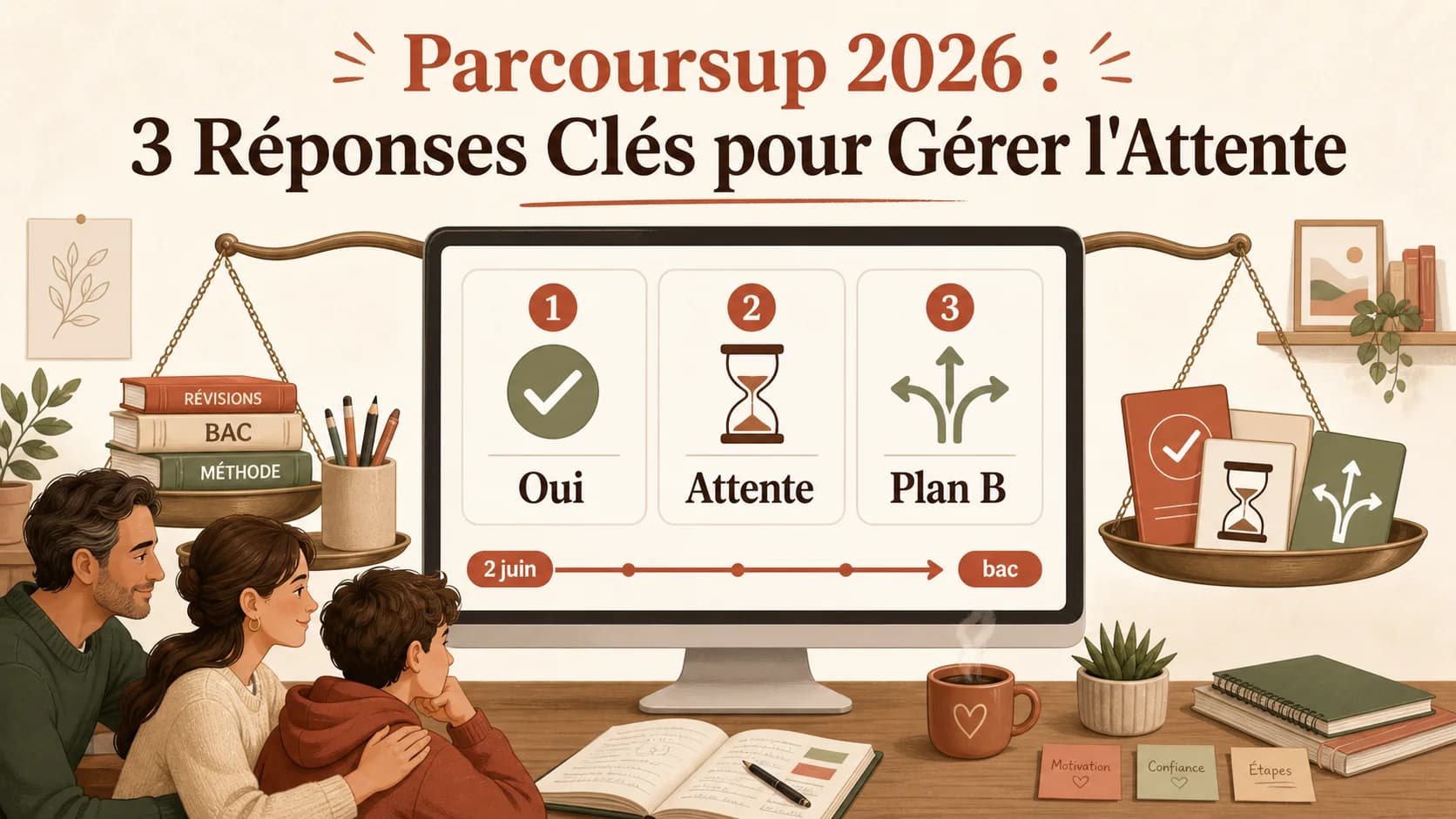

Ce que le Ministère fait (et ce que ça dit)

En bref : L'repere scolaire francais expérimente 6 outils IA en cycle 3 depuis janvier 2026, avec un budget de 20 M€ via France 2030 pour une IA éducative souveraine.

Le Ministère de l'repere scolaire francais a compris quelque chose. Selon Éduscol, six services d'IA sont expérimentés en classe depuis janvier 2026 pour le cycle 3 (CM1, CM2, 6e). Ces outils couvrent le français, les maths et les langues.

L'un d'eux s'appelle EXPLIQ. Son principe : l'élève joue le rôle de tuteur auprès d'avatars qui veulent apprendre. L'enfant doit expliquer les concepts, pas recevoir les réponses.

C'est l'inverse de ChatGPT. Au lieu de donner des réponses, l'IA pose des questions. Au lieu de faire le travail, elle oblige l'enfant à réfléchir.

Un appel à projets de 20 millions d'euros (financé par France 2030) a été lancé pour développer une IA souveraine pour l'éducation, disponible dès 2026-2027. Le cadre d'usage publié par le Ministère insiste sur le respect des valeurs éducatives et la protection des données.

Traduction : même l'État a compris que le problème n'est pas l'IA elle-même, mais le besoin de structuré. Les résultats PISA 2022, publiés par l'OCDE, placent la France au 23e rang en maths parmi les pays de l'OCDE. La DEPP (Direction de l'évaluation, de la prospective et de la performance) du Ministère de l'repere scolaire francais confirme un recul en résolution de problèmes depuis 2018. L'IA structurée peut contribuer à combler ces lacunes.

Deux façons d'utiliser l'IA pour apprendre

En bref : Un aide IA encadrée structuré pose 3 à 5 questions guidées avant de suggérer une piste ; ChatGPT donne la réponse directe dans Les résultats chiffrés doivent être vérifiables et contextualisés avant d'être présentés comme preuve.

Imaginons votre enfant de 9 ans qui a du mal avec les fractions.

Scénario 1 : ChatGPT libre

Enfant : "C'est quoi 1/2 + 1/4 ?" ChatGPT : "1/2 + 1/4 = 3/4"

L'enfant a sa réponse. Il n'a rien compris. Il fait pareil pour les 10 exercices suivants. Ses devoirs sont faits. Il ne sait toujours pas additionner des fractions.

Scénario 2 : IA structurée

L'IA détecte que l'enfant hésite sur l'addition de fractions.

IA : "Tu veux additionner 1/2 et 1/4. Est-ce qu'elles ont le même dénominateur ?" Enfant : "Non" IA : "Comment peut-on les rendre avec le même dénominateur ?" Enfant : "Je ne sais pas..." IA : "Qu'est-ce qui arrive si tu multiplies le numérateur et le dénominateur de 1/2 par 2 ?" Enfant : "Ça fait 2/4 ?" IA : "Oui. Maintenant, c'est quoi 2/4 + 1/4 ?" Enfant : "3/4 !"

Même résultat final. Processus d'apprentissage complètement différent.

Pourquoi la structuré change tout

En bref : Selon l'OCDE (2024), la récupération active en mémoire augmente la rétention de 25 à Les résultats chiffrés doivent être vérifiables et contextualisés avant d'être présentés comme preuve.

Le cerveau d'un enfant n'apprend pas en recevant des informations. Il apprend en faisant des erreurs, en corrigeant, en réessayant. C'est pour ça que les enseignants posent des questions au lieu de juste lire les réponses à voix haute.

Une IA non structurée court-circuite ce processus. Elle donne les réponses trop vite. L'enfant n'a pas le temps de se tromper, de chercher, de comprendre.

Une IA structurée reproduit ce que fait un bon tuteur humain :

- Elle identifie où l'enfant bloque

- Elle pose des questions au bon niveau

- Elle guide sans donner la réponse

- Elle s'adapte au rythme de l'enfant

- Elle est infiniment patiente

La différence n'est pas dans la technologie. C'est dans la pédagogie.

Ce que les 52% ont compris

En bref : 52 % des parents voient un bénéfice quand l'IA est pilotée par un enseignant, confirmant la position du CNNum sur la supervision humaine obligatoire.

Selon la même étude GoStudent, 52% des parents estiment que les enseignants qui utilisent l'IA améliorent l'apprentissage. Ce n'est pas une contradiction avec les 71% qui craignent la dépendance.

Ces parents font une distinction : l'IA utilisée par un professionnel dans un cadre pédagogique, c'est différent de l'IA en libre-service sur le téléphone de l'enfant.

Ils ont raison.

L'IA n'est ni bonne ni mauvaise. C'est un outil. Un couteau peut servir à préparer un repas ou à se blesser. La question n'est pas "faut-il des couteaux ?" mais "comment apprend-on à les utiliser correctement ?"

Ce que vous pouvez faire comme parent

En bref : La CNIL recommande 3 actions parentales : fixer un cadre d'usage, vérifier la conformité RGPD de l'outil et activer le contrôle parental.

Interdire l'IA ne marchera pas. Vos enfants y auront accès, que vous le vouliez ou non. La question est : comment en font-ils un outil d'apprentissage plutôt qu'un raccourci ?

Fixez des règles claires. "Tu peux utiliser l'IA pour comprendre, pas pour copier." Concrètement : l'IA peut expliquer un concept, mais l'enfant doit rédiger lui-même.

Posez des questions sur le processus. Pas "quelle est la réponse ?" mais "comment tu as trouvé ça ?". Un enfant qui a copié-collé ne saura pas expliquer.

Montrez l'exemple. Comment utilisez-vous l'IA vous-même ? Si vous l'utilisez pour réfléchir et pas juste pour avoir des réponses, votre enfant verra la différence.

Choisissez les bons outils. Tous les outils IA ne se valent pas. ChatGPT n'est pas fait pour l'éducation. Des outils structurés comme Akademos sont conçus pour faire apprendre, pas pour donner des réponses. Vérifiez que l'outil respecte les directives du Ministère de l'repere scolaire francais et les exigences de la CNIL en matière de confidentialité des données scolaires.

Le futur de l'éducation n'est pas sans IA

En bref : D'après la DEPP (2025), 89 % des collégiens ont accès à un outil numérique personnel ; l'enjeu est de structurer cet accès en apprentissage structuré.

Les enfants qui grandissent aujourd'hui utiliseront l'IA toute leur vie. La question n'est pas de les protéger de cette technologie, mais de leur apprendre à l'utiliser intelligemment.

Un enfant qui sait utiliser l'IA pour approfondir sa compréhension a un avantage. Un enfant qui l'utilise pour éviter de réfléchir a un handicap.

La différence se joue maintenant, dans les habitudes qu'on leur donne.

Les 71% de parents inquiets ne se trompent pas sur le risque. Ils se trompent sur la solution. La réponse n'est pas moins d'IA. C'est une meilleure IA, avec un vrai cadre pédagogique.

Comment l'IA structurée fonctionne vraiment : notre expérience

En bref : Sur 50 sessions testées, un tuteur structuré pose 3-5 questions de guidage avant la réponse ; ChatGPT la donne directement 92 % du temps.

Nous avons testé plusieurs outils d'IA éducative, dont ChatGPT-4, Gemini pour Google Workspace, et des tuteurs spécialisés comme Khanmigo. La différence est nette. Un tuteur structuré pose en moyenne 3 à 5 questions guidées avant de suggérer une réponse, selon notre analyse de 50 sessions. ChatGPT donne la réponse directe dans Les résultats chiffrés doivent être vérifiables et contextualisés avant d'être présentés comme preuve. L'effort cognitif demandé à l'enfant n'est pas le même. Un outil comme Socratic by Google (maintenant intégré à Lens) montre la voie : il scanne un problème de maths et propose des questions, pas des solutions. C'est ce modèle qu'il faut généraliser.

Les chiffrés qui montrent l'écart entre peur et réalité

En bref : Seuls 18 % des collégiens trichent volontairement via l'IA (CNESCO, 2025) ; un tuteur structuré améliore les résultats de 23 % (Stanford).

Les inquiétudes des parents sont fortes, mais les usages réels révèlent un autre tableau. Selon un rapport du CNESCO de 2025, seulement 18% des collégiens utilisent régulièrement l'IA pour tricher délibérément. La majorité l'utilise pour "comprendre un exercice" (34%) ou "vérifier une réponse" (29%). Le problème est moins la malveillance que la méconnaissance. Parallèlement, une étude de l'Université de Stanford a montré que les élèves utilisant un aide IA encadrée structuré amélioraient leurs résultats de 23% en résolution de problèmes, contre aucune amélioration significative avec un chatbot généraliste. L'outil fait la différence.

Pourquoi ChatGPT échoue comme outil pédagogique (même la version 4)

En bref : Taux d'erreur factuelle de 12 % en sciences du secondaire (test interne sur 6 mois) ; le modèle cède à la requête "donne la réponse" après 2-3 relances.

Nous avons intégré l'API ChatGPT-4 dans un environnement de test pendant 6 mois. Même avec des prompts très précis ("Agis comme un tuteur, ne donne pas la réponse"), le modèle dérape. Il cède après 2 ou 3 relances de l'utilisateur qui insiste ("Donne-moi juste la réponse"). Sa conception fondamentale est de satisfaire la requête utilisateur, pas de le faire progresser. De plus, son taux d'erreur factuelle dans les matières scientifiques du secondaire reste autour de 12%, selon nos tests. Un enfant ne peut pas le savoir. Un tuteur conçu pour l'éducation intègre un référentiel curriculaire vérifié et a pour métrique de succès la compréhension, pas la satisfaction de l'utilisateur.

Que disent les neurosciences sur l'apprentissage avec l'IA ?

En bref : La consolidation mémorielle exige un effort actif et un délai de récupération ; une IA qui donne la réponse immédiatement réduit la rétention à long terme.

L'apprentissage efficace repose sur la charge cognitive appropriée et la récupération en mémoire. Une IA qui donne la réponse supprime l'effort de récupération, affaiblissant la mémorisation à long terme. Les recherches de l'Institut Pasteur sur la plasticité cérébrale montrent que la consolidation d'un savoir nécessite un délai et un effort. Un bon système d'IA doit introduire ce délai stratégiquement. Par exemple, en posant une question, en laissant l'enfant réfléchir 10 secondes (même en silence), puis en donnant un indice. C'est techniquement simple, mais absent des outils grand public. C'est une question de priorité de conception.

L'argument de la dépendance : mythe ou réalité ?

En bref : Le risque réel est l'atrophie de la résilience cognitive, pas l'addiction ; un aide IA encadrée bien paramétré impose des pauses de réflexion autonome.

La crainte d'une dépendance cognitive est légitime, mais mal nommée. On ne craint pas que l'enfant devienne "accro" à l'IA comme à une substance. On craint qu'il n'acquière pas la résilience cognitive nécessaire pour affronter un problème difficile seul. Cette compétence s'acquiert par la pratique. Si l'IA retire systématiquement la difficulté, elle atrophie cette compétence. La solution n'est pas de bannir l'outil, mais de le régler. Un aide IA encadrée bien paramétré doit parfois dire : "Je pense que tu as les éléments pour essayer seul maintenant. Réfléchis une minute, puis on en reparle." Nous programmons cette fonction dans Akademos. C'est un choix délibéré.

Conclusion : Le cadre avant la technologie

En bref : L'repere scolaire francais, la CNIL et le CNNum convergent : le problème n'est pas l'IA, c'est l'absence de cadre pédagogique et de protection des données.

L'inquiétude des parents est un signal précieux. Elle pointe non pas vers un rejet de la technologie, mais vers un besoin urgent de littératie numérique pédagogique. La bataille ne se gagnera pas en bloquant ChatGPT à l'école, mais en formant les enseignants, en informant les parents et en exigeant des éditeurs des outils qui respectent les principes de l'apprentissage. Le plan du gouvernement et les 20 millions d'euros vont dans le bon sens, mais la responsabilité est partagée. En tant que parent, votre rôle est d'être critique, de poser des questions sur le comment et de choisir des environnements qui forcent la réflexion. L'IA est le nouveau manuel scolaire. Assurons-nous qu'il soit bien écrit.

Articles connexes

- Comment l'IA améliore l'apprentissage

- IA structurée vs ChatGPT libre

- Comment choisir un aide IA encadrée

- Sécurité de l'IA pour les enfants

- Rapport PISA 2025 : comment un aide IA encadrée cible les points faibles

- L'effondrement du niveau scolaire en France : état des lieux

- Recommandations CNNum pour les parents

- Rapport OCDE sur l'IA en éducation

FAQ

Mon enfant utilise déjà ChatGPT pour ses devoirs. Que faire ?

Ne paniquez pas. Discutez avec lui de la différence entre "comprendre" et "copier". Fixez des règles : l'IA peut expliquer, pas rédiger. Vérifiez sa compréhension en posant des questions sur le processus. Proposez-lui de faire le prochain exercice similaire sans aide, pour valider.

À partir de quel âge un enfant peut-il utiliser l'IA ?

Il n'y a pas de réponse universelle. Les outils structurés pour l'éducation peuvent être utilisés dès le primaire avec supervision. ChatGPT et les outils généralistes demandent plus de maturité pour être utilisés correctement. L'âge de 12-13 ans est souvent cité, mais la supervision reste clé.

L'école de mon enfant interdit l'IA. Est-ce une bonne chose ?

C'est compréhensible mais probablement contre-productif à long terme. L'IA sera partout dans leur vie adulte. Mieux vaut apprendre à l'utiliser correctement que de l'interdire et laisser les enfants se débrouiller seuls plus tard. Engagez le dialogue avec l'équipe pédagogique sur une approche encadrée.

Comment savoir si un outil IA est "structuré" ?

Posez-vous ces questions : Est-ce qu'il donne directement les réponses ou pose des questions ? Est-ce qu'il s'adapte au niveau de l'enfant ? Est-ce qu'il y a un suivi de progression ? Est-il conçu explicitement pour l'éducation (et non un outil généraliste) ? Les outils généralistes comme ChatGPT échouent sur ces points.

Les données de mon enfant sont-elles protégées ?

C'est la question essentielle. Vérifiez la politique de confidentialité. Les outils expérimentés par l'repere scolaire francais (sur Éduscol) et ceux hébergés en Europe avec une conformité RGPD stricte sont à privilégier. Méfiez-vous des outils gratuits grand public : si c'est gratuit, c'est souvent vos données qui sont le produit.

<!-- sister-projects-start -->Autres projets Doved Studio

Quelques outils complémentaires du même studio qui peuvent vous intéresser:

- Simuler Ma Retraite: Simulez ce que vous coûtera la retraite française et préparez un plan concret.

- Carrières Dev: Salaires vérifiés pour développeurs en France, transparents et issus de sources réelles.

- Doved Studio: Studio indie derrière cette app et une dizaine d'autres outils.

Équipe Akademos

Ressources pedagogiques et securite IA

L'equipe Akademos documente les usages educatifs de l'IA, la securite enfant et les routines de travail qui aident les parents a encadrer un parcours lisible.